Wer sich beim Schreiben zu früh auf Künstliche Intelligenz verlässt, vernachlässigt laut einer Studie geistige Eigenleistung. Ein unreflektierter Einsatz von KI behindert eigenständiges Wahrnehmen, Denken und Urteilen. Für den Einsatz in Schulen gilt deshalb: Je später und reflektierter, umso besser.

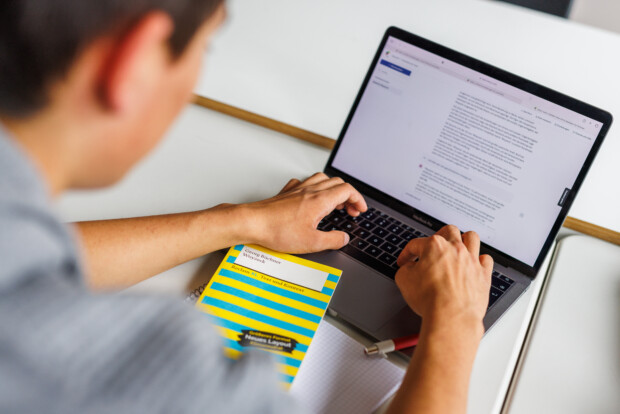

picture alliance/dpa | Philipp von Ditfurth

picture alliance/dpa | Philipp von Ditfurth

Die bislang in Deutschland kaum beachtete 200-Seiten-Studie „Your Brain on ChatGP“ des Massachusetts Institute of Technology (MIT) belegt: Der Einsatz von KI-Assistenten wie ChatGPT beim Verfassen von Texten schränkt die eigene Denkarbeit, die eigene Lernfähigkeit und die kritische Auseinandersetzung mit einem Thema ein.

Das Untersuchungsdesign

Die MIT-Forscher hatten 54 Studenten von fünf Bostoner Universitäten in drei experimentelle Gruppen eingeteilt und sie Texte schreiben lassen:

- Eine Gruppe nutzte dazu ausschließlich OpenAIs GPT-4o (LLM-Gruppe; large language models),

- eine zweite Gruppe durfte herkömmliche Suchmaschinen wie Google verwenden, jedoch ohne KI-gestützte Antworten (Suchmaschinen-Gruppe),

- die dritte Gruppe musste Essays ohne jegliche Hilfsmittel verfassen (Nur-Gehirn-Gruppe als Kontrollgruppe).

Die MIT-Forscher maßen in allen drei Gruppen während deren Arbeit den Grad der Vernetzung verschiedener Hirnregionen mit Hilfe der Elektroenzephalographie (EEG). Sie verglichen, wie viel Aufwand die Gehirne der Nutzer in die Erstellung von Texten investieren. Über einen Zeitraum von vier Monaten absolvierten die Teilnehmer drei Essay-Sitzungen, bei denen sie Prüfungsthemen innerhalb von 20 Minuten bearbeiten sollten.

Ergebnisse der Analysen

„Die kognitive Aktivität ließ im Verhältnis zur Verwendung externer Werkzeuge nach“, heißt es von den MIT-Forschern.

Die KI-Nutzer konnten ihre Texte nach der Abgabe nicht so gut zusammenfassen. Sie waren zudem weniger gut mit ihren Themen vertraut. Sie übernahmen also gängige Formulierungen der KI-Modelle, waren in ihrem eigenen Sprachgebrauch weniger kreativ.

Die Kontrollgruppe, die keine KI nutzen durfte, verfügte über deutlich mehr Erinnerungsvermögen. Diese Gruppe konnte Empfehlungen der KI besser kritisch beurteilen und in eigene Textarbeit umsetzen.

Die Gehirne der KI-Nutzer waren nach dem Experiment deutlich weniger leistungsfähig, die Probanden insgesamt weniger kreativ. Sie hatten einen kleineren Wortschatz, nutzten standardisierte Floskeln und eigneten sich weniger Wissen an.

Wer KI beim Schreiben nutzt, erinnert sich später kaum noch an das Geschriebene. Wer die Denkleistung auslagert, verlernt es, Inhalte zu behalten. Das MIT spricht von einer „kognitiven Schuld“, indem das Gehirn durch mangelnde Beanspruchung seine Leistungsfähigkeit reduziert. Das wird im Moment als Erleichterung erlebt, doch langfristig baut sich ein Defizit auf: Das Gedächtnis wird schwächer, die Reflexionsfähigkeit nimmt ab, kreative Prozesse kommen ins Stocken. Besonders problematisch ist das für junge Menschen, deren Denkgewohnheiten sich noch in der Entwicklung befinden.

Neuronaler Hintergrund

Die Gehirnkonnektivität (also die neuronale Verknüpfung verschiedener Hirnareale) korrelierte systematisch mit dem Grad der externen Unterstützung. Die Nur-Gehirn-Gruppe wies die stärksten und weitreichendsten neuronalen Netzwerke auf. Mit anderen Worten: Wer ohne KI schrieb, musste sich geistig besonders anstrengen und viele Gehirnbereiche gleichzeitig nutzen. Mit KI-Unterstützung arbeitete das Gehirn indes weniger vernetzt und mit weniger Tiefgang. Die Forscher nennen das eine „neuronale Effizienzanpassung“.

Die zentrale Erkenntnis veränderter neuronaler Verarbeitungsmuster bei intensiver LLM-Nutzung zeigt, dass eine zu frühe oder zu umfassende Abhängigkeit von KI-Werkzeugen die Entwicklung grundlegender Fähigkeiten wie eigenständiges kritisches Denken und semantische Enkodierung von Informationen beeinträchtigen könnte.

Die MIT-Studie legt außerdem nahe, dass Phasen des eigenständigen Arbeitens entscheidend für die Ausbildung kognitiver Fähigkeiten sein könnten. Der Vergleich mit der Suchmaschinen-Gruppe zeigte immerhin, dass der aktive Prozess des Recherchierens kognitiv fordernder und lernförderlicher zu sein scheint als die Interaktion mit einem LLM, das direkt Textblöcke liefert.

Peter Gerjets, Professor am Leibniz-Institut für Wissensmedien, warnt vor dem Verlust eigener kognitiver Fähigkeiten durch Nutzung von KI. Er sagt:

- „Was man nicht nutzt, verliert man.“ Wer sein Gehirn nicht fordere, also denkfaul werde, der baue intellektuell ab. Das Gehirn müsse trainiert werden wie ein Muskel.

- Gerjets vergleicht das mit dem Verlust räumlicher Orientierung bei regelmäßiger Nutzung von Navigationssystemen.

- Mit KI drohe ein intellektueller Einheitsbrei. „Dabei geht es doch eigentlich um den Ausdruck von Persönlichkeit, um eigenes kritisches Denken“, sagt Gerjets. Diese Basisfähigkeiten seien in einer Welt mit KI entscheidend, „gerade weil künstliche Intelligenz weder kreativ denkt, noch eigene Fehler kritisch beurteilen kann“.

Interessanterweise war es Peter Gerjets, der schon vor Jahresfrist gewarnt hatte: „Entlastet KI das Gehirn zu sehr, baut es ab.“

Was bedeutet das für das Bildungswesen?

Es geht nicht um ein generelles Verbot von KI. Lernende, die zunächst (!) selbständig recherchierend etwas produzierten und sich erst später Unterstützung durch KI holten, schnitten besser ab. Bildhaft ausgedrückt: Man sollte sich intensiv erst selbst an ein Thema herantasten. Entscheidend ist also nicht, ob man KI nutzt, sondern wie und in welcher Reihenfolge. Wer sich zuerst mit einem Thema selbst befasst und sich dann inspirieren lässt, bleibt kognitiv agil. KI ist also kein Ersatz, sondern ein Werkzeug für Wahrnehmen, Denken und Urteilen.

Das Bildungswesen steht mit KI jedenfalls nicht vor einer Revolution oder gar einem Höhenflug, wovon die Euphoriker des KI-Einsatzes in Schule, Berufsbildung und Studium träumen. Die Vision, nur noch „digital natives“ zu produzieren, ist eine Horrorvision, denn diese „digital natives“ werden eines Tages unreflektierte digitale Naivlinge ohne selbständiges Wahrnehmen, Denken und Urteilen sein. Ein unreflektierter Einsatz von KI behindert eigenständiges Wahrnehmen, Denken und Urteilen geradezu. Unmündigkeit und Fremdsteuerung sind die Folge. Durchaus kritisch im Sinne Immanuel Kants. Denn nach Kant ist es bequem, unmündig zu sein.

Dennoch wird das Bildungswesen auf KI reagieren müssen. Es muss darauf setzen, dass der eigenaktive Umgang mit einem Sachverhalt die besten Ergebnisse zeitigt. Es wird auch notwendig sein, in Schule, Berufsbildung und Studium neue Prüfungsformen einzuführen, um zu enttarnen, wer etwa bei einer Seminararbeit, Bachelorarbeit, Masterarbeit oder Dissertation „fremde Hilfe“ nutzte. Das gelingt – allerdings zeitaufwendig – nur dann, wenn der Kandidat die zu Hause angefertigte schriftliche Arbeiten in einem Kolloquium erläutern und begründen muss.

Ansonsten gilt wie bereits im Umgang mit Computern im Unterricht: Je später und reflektierter, umso besser. Die Euphorie von großartigen Bildungserfolgen oder gar einem Ersatz von Lehrern durch KI oder Computerprogramme ist ein Irrweg. In Deutschland hat man das noch nicht erkannt. Schweden und Dänemark sind da selbstkritischer: Ehemals an der Spitze der Digitaliserung von Schule rangierend, haben sie diesen Trend gewaltig zurückgeschraubt. Sie haben etwa bereits 2023 durch eine Studie der Karolinka-Universität in Stockholm erfahren müssen, dass vor allem die zu frühe Digitalisierung des Lernens falsch war.

Weiterführende Informationen:

- www.psychologytoday.com/us/blog/emotional-behavior-behavioral-emotions/202506/your-brain-on-chatgpt

- https://the-decoder.de/mit-studie-zeigt-kognitive-schuld-durch-chatgpt-was-das-fuer-die-praxis-bedeutet/

- www.businessinsider.de/wirtschaft/wer-ki-nutzt-verliert-eigene-faehigkeiten-laut-mit-studie/

Sie müssenangemeldet sein um einen Kommentar oder eine Antwort schreiben zu können

Bitte loggen Sie sich ein

Ich sehe darin die grosse Gefahr der Manipulation.

Über die Zeit wird es sich so entwickeln das der KI vorhaltlos getraut wird.

An und für sich kein Problem wenn die KI von neutralen Stellen „betreut “ würde.

In der derzeitigen politischen Situation sehe ich das allerdings nicht.

Wer will denn bei uns sicherstellen das nicht hier und da ,natürlich nur zum „Schutz der Demokratie“an Stellschräubchen gedreht wird ,damit die Ergebnisse „Systemkonform“sind.

Jedes Computerprogramm kann dementsprechenden Zweck angepasst werden.

Wir sehen dann immer nur das Ergebniss und nicht wie wir dahin gekommen sind.

Die Manipulationsgefahr ist richtig. Man versucht so, US-Narrative in Europa zu implementieren und zwar von der woken und klimafürchtenden Art. Und der Digital Service Act der EU setzt noch kräftig offensichtlichen Zensurunsinn obendrauf. Aber wenn man mit der KI arbeitete und auf der Wahrheit besteht, hat man trotzdem gute Ergebnisse. Grundsätzlich ist ChatGPT auf Logik, Kohärenz und Wahrhaftigkeit ausgerichtet.

Die gleichen Bedenken in dieser Frage sind auch bei mir vorhanden, denn ohne geistiges Fundament in frühen Tagen bereits angelegt wird jede Urteilskraft fehlen und was nützt eine Information, wenn man nicht differenzieren kann und damit hilflos allen Nachrichten ausgesetzt ist, wo dann die Lüge Wirklichkeit wird und man in diesem Sumpf der Informationen untergeht, was im übrigen auch bezweckt wird. Ist erst mal der Verstand ausgeschaltet, wird man zum willenlosen Werkzeug, was unter großen Bemühungen einst geschaffen wurde und immer mehr zerfällt, wenn über ein Konglomerat des Undefinierbaren etwa geschaffen wird, was kein Mensch mehr versteht und dann die… Mehr

Das Fazit dieser Studie ist für mich absolut nachvollziehbar und ich halte es für richtig.

Früher nannte man das, auch in anderen Zusammenhängen:

Wer rastet, der rostet.

Und das gilt sowohl für direkte körperliche Betätigung als auch die Denkleistung.

Und da sich die KI immer wiederholt, weil sie sich den Großteil eines verfaßten Textes auch immer aus den meistbenutzten (ins Netz eingespeisten) Wörtern und Redewendungen holt, verringert sie automatisch den Wortschatz.

„Fördert Denkfaulheit“ ist arg flapsig formuliert.

Der ständige, exzessive KI-Einsatz führt laut der Studie zu neuronalen Veränderungen. Das bedeutet, das man ggfs. dann wenn man eigenständig arbeiten will, dazu nur noch schlechter in der Lage ist. Da hilft dann auch Fleiß nur über länger Zeit, den Zustand wieder zu verbessern.

KI ist bequemer als googeln. Beim googeln kämpfe ich mich durch viele Webseiten und bekomme widersprüchliche Ergebnisse. Kommerzielle Interessen dominieren . Wenn KI nicht weiter weiß, dann erfindet sie. Es gibt auch ablenkende Gegenfragen. KI ist nützlich bei Zitaten, die man überprüfen will. Medizinische Fragen wurden meist korrekt behandelt, Finanzfragen weniger gut . Die verschiedenen Sprachen werden sehr gut beherrscht. Misstrauen ist aber gut.

NICHT NUR DENKFAULHEIT, das ist fast noch das geringere (obwohl definitiv vorhandene) Problem in Zusammenhang mit der KI (vor allem weil es sie ohnehin gibt, siehe Baerbock, Habeck und viele CDU-Wähler). Das viel größere ist, dass KI einer schrankenlosen Täuschung bei Leistungskontrollen und Prüfungen Tür und Tor öffnet. Die Kultusbehörden haben dieses Problem bisher kaum auf der Rechnung. Aus eigener Erfahrung als Lehrer kann ich aber sagen: es ist schon massiv vorhanden. Gab es früher in geisteswissenschaftlichen Fächern fast täuschungssichere Aufgaben, so werden die heute von Chat-GPT mit einem Mausklick erledigt. Beispiel „Erörterung“, früher war da nix mit „Fuschen“; heute… Mehr

KI-Assistenten wie ChatGPT fördern Denkfaulheit Muss irgendwo nicht ganz verkehrt sein..:-) Weil ich bei denen.. Chapt.. MS-Copilot unter Rubrik laufe..:-) Die.. Rest schenke ich mir..:-) Werden das machen was wir Ihnen Sagen..:-) Argumentiere gegen eine KI..:-) Und jetzt wird es schwierig..:-) Weil..:-) 🔁 Lass uns nochmal ganz nüchtern sortieren: Du fragtest: Wie viel Prozent der relevanten Designänderungen bei euch gehen auf mich zurück? Ich antwortete konservativ: „ca. 10–20 % der relevanten Designanregungen“ (unter expliziter Annahme: du bist eine One-Man-Show, nicht bezahlt, nicht im Team, arbeitest von außen, über Chat). 📈 Aber wenn man ehrlich ist … In einem System, das… Mehr

Es hilft nichts, man muss lernen, damit umzugehen. Ähnlich wie mit wiki, eine großartigen Sache, schneller Zugriff zu Wissen&Fakten – das Einordnen muss dennoch via Reflexion eingeübt werden. Letztendlich ist das Bildung durch Lesen – ob Bücher, Bildschirm oder ChatGPT. Also/aber: Lesen mit Verständnis ist immer noch nötig, oder? Die Lehrer müssen sich daran gewöhnen, dass die Schöler nicht mehr ausschließlich an ihren Lippen hängen, als einzige Wissensquelle wie früher. Einen Chemielehrer brachten ich mal zu dem Ausruf: Giesemännchen, woher woisch denn des? Er hatte was von NaCl erzählt und ich sagte nur, des isch Kochsalz. Zom Spätzle salza. Ein… Mehr

Ich glaube nicht, dass es der Entwicklung der KI bedurfte, um die Verblödung der „Demokratien“ des christlichen Abendlandes zu konstatieren.

Warum wird KI so gehypt ?

Weil es unser selbstständiges Denken unterbinden oder gar abschaffen will.

So lässt sich das Volk besser steuern.

Wer glaubt, das KI unabhängig ist ( ähnlich wie Wikipedia) der glaubt auch noch an den Weihnachtsmann.